Des deepfakes sophistiqués à l'assaut des finances des entreprises

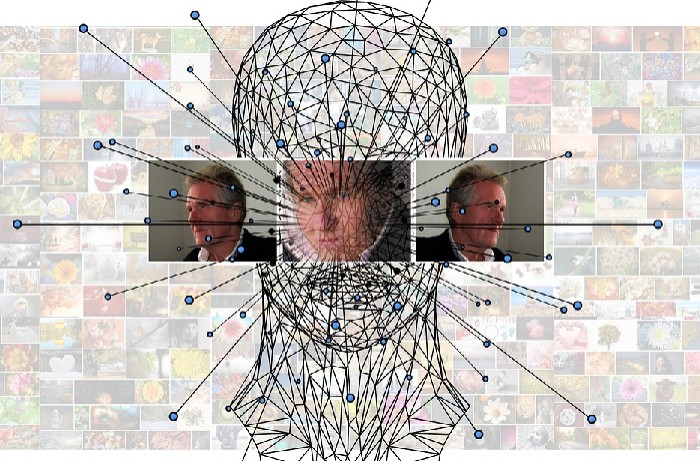

Après les personnalités de la politique et du spectacle, les deepfakes ciblent désormais aussi les responsables d'entreprise. Les hackers se font passer pour ces derniers, y compris au sein de visioconférences, afin d'extorquer des fonds aux organisations.

PublicitéSelon une enquête menée par le cabinet de conseil Deloitte, près de 15 % des dirigeants affirment que des cybercriminels ont ciblé leurs données financières ou comptables à l'aide de deepfakes au moins une fois au cours de l'année écoulée. 11 % confirment même avoir été victimes de plusieurs escroqueries de ce type. Ces techniques de falsification par l'IA d'images, de sons, de vidéos ou de tout type de données ont longtemps été un cauchemar réservé aux personnalités de la politique ou du spectacle. Les réponses à l'enquête Deloitte confirment qu'elles ciblent désormais aussi les entreprises.

Outre le risque cyber, la situation implique aussi des risques financiers. Elle ne concerne ainsi pas que les DSI et les RSSI, mais aussi la direction des risques. L'agence de notation Moody's a d'ailleurs publié au printemps une mise en garde spécifique le confirmant. Le rapport détaille quelques tentatives d'escroquerie par deepfake, y compris de faux appels vidéo, qui ont visé le secteur financier au cours des deux dernières années. « Les deepfakes peuvent être utilisés pour créer des vidéos frauduleuses de responsables dans des banques, de dirigeants d'entreprises ou de fonctionnaires afin de rediriger des transactions financières ou d'effectuer des paiements frauduleux », précise le document. Des versions beaucoup plus sophistiquées et variées que les bonnes vieilles fraudes téléphoniques au président.

Un nouveau champs des possibles pour les pirates

L'enquête de Deloitte a été conduite auprès de plus de 1 100 dirigeants d'entreprises lors d'un webinaire en mai sur la confiance dans l'IA générative. Environ la moitié de ceux qui n'ont pas répondu avoir constaté d'attaque par deepfake, disent soit ne pas se sentir concernés, soit ne pas savoir si leur organisation a été ciblée. Il se peut ainsi que toutes les organisations réellement ciblées ne se déclarent pas, comme le précise Michael Bondar, global enterprise trust leader chez Deloitte, car les escroqueries par deepfake sur les données financières restent encore relativement récentes. « Lorsque de tels incidents se produisent, les organisations sont peu enclines à s'en vanter, ajoute-t-il. En réalité, nous parlons d'une toute nouvelle étendue de nouvelles possibilités ».

Plus de la moitié des personnes interrogées s'attendent à ce que le nombre d'escroqueries financières par deepfake augmente au cours de l'année à venir. Pour lutter contre ce phénomène, pour l'instant, elles se contentent de communiquer avec leurs employés, de leur proposer des formations, de déployer de nouvelles politiques de protection ou de nouvelles technologies. Mais environ 10 % affirment que leur entreprise ne fait rien et près d'un tiers ne sait pas ce qu'elle met en place ou ne se sent pas concerné.

PublicitéDes deepfakes sophistiqués et documentés

« Les deepfake d'appels vocaux sont de plus en plus courants, mais la visioconférence est désormais aussi concernée », comme le précise Mike Weil, digital forensics leader et managing director de Deloitte Financial Advisory Services. La version deepfake de la fraude au président. « Cela fait passer l'ingénierie sociale à un niveau supérieur. D'une part, vous parlez avec cette personne, mais d'autre part, elle détient beaucoup d'informations dont vous pensez qu'elle est la seule à les connaître. Les pirates sont ainsi capables d'interagir avec vous d'une manière qui semble tout à fait légitime ».

« Il s'agit d'attaques hautement coordonnées et sophistiquées, préparées en amont avec de la collecte de renseignements sur votre organisation ou vos clients, poursuit Mike Weil. Ce ne sont pas des attaques aléatoires. Elles ciblent au contraire spécifiquement les points faibles au sein de l'organisation. Et l'objectif est d'en tirer de grosses sommes d'argent ».

De faux participants en visioconférence

Pour Deloitte, pour se protéger contre ces attaques par deepfake, il faut assez classiquement éduquer et former les employés, et s'assurer que la direction suit scrupuleusement les processus internes pour le transfert de grosses sommes d'argent, par exemple. Sans oublier les exercices internes pour vérifier si les employés peuvent tomber dans ce type de piège.

Quant aux solutions de détection de deepfakes, leurs éditeurs utilisent aussi l'IA pour contrer les méthodes des hackers.

Une classique course aux armements dans ce domaine au croisement de la cybersécurité et de l'IA. Pour Kevin Surace, CTO d'Appvance, fournisseur d'outils de test de logiciels alimentés par l'IA, « n'importe qui aujourd'hui peut créer un message vocal deepfake sans aucune compétence ». Mais il insiste sur l'augmentation de la fréquence des appels vocaux interactifs deepfake et même d'interventions de faux participants dans des appels vidéo, même si cela nécessite davantage de connaissances techniques. Des méthodes en forte croissance qui devraient, selon lui, exploser d'ici à la fin 2025.

Article rédigé par

Grant Gross, IDGNS (adapté par E.Delsol)

Commentaire

INFORMATION

Vous devez être connecté à votre compte CIO pour poster un commentaire.

Cliquez ici pour vous connecter

Pas encore inscrit ? s'inscrire